2.Вер-ть попадания НСВ в инт-вал [а,b]вычисляется во формуле

3.  и

и

. График ф-ии p(x) называется кривой плотности вер-ти.

23. Математическое ожидание и дисперсия непрерывной случайной величины Мат.ожид. НСВ Х, знач., кот. х принадлежат (  ) с плотностью вероят.р(х), вычисл. по формуле:

) с плотностью вероят.р(х), вычисл. по формуле:  (требуется абсолют.сходимость интеграла.) Если НСВ X определена на[

(требуется абсолют.сходимость интеграла.) Если НСВ X определена на[  ],то мат.ожид. опред. по формуле

],то мат.ожид. опред. по формуле

Дисперсия НСВ X, знач. кот. принадлежат инт-лу (  )с плотностью вер-ти р(Х) вычисляется по формуле:

)с плотностью вер-ти р(Х) вычисляется по формуле:

(требуется абс. сход. интеграла)

(требуется абс. сход. интеграла)

Если все знач. НСВ принадлежат инт-лу (  ), то дисперсия вычисл.по формуле:

), то дисперсия вычисл.по формуле:

Или равносильным рав-вом:

24. Равномерный закон распределения и его числовые характеристики Непр. случ. велич.х распред. равномерно на отрезке [а;b], если её плотность вероятности р(х) постоянна на этом отрезке и равна 0 вне его:

Р(х)= {1/ (b-a), при а< =х<=b,

{О, при х<а, х>b

Пример: ожидание транспорта на остановке.

Функция распред. случайн. величины, распред-ой по равномерн. закону, имеет вид:

F(x)= { O, x<=a,

{(x-a)/(b-a), a<=x<=b,

{1, x>b

Мат. ожидание, дисперсия, средн. кв. откл-е:МХ=(а+b)/2; DХ=  ,

,

25. Показательный закон распределения и его числовые характеристики. Непрерывная СВ Х имеет показ. (экспоненциальное) распределение с параметром λ >0, если ее плотность распред-я имеет вид:

Ф-ция распределения СВ, распределенной по показ. з-ну:

Показательному распределению обычно подчиняется время ожидания в очереди. Вероятность попадания случайной величины Х на интервал (α;β)

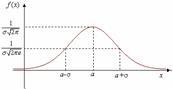

26. Нормальный закон распределения. Влияние параметров распределения на вид нормальной кривой. Непрерывная случайная величина X имеет нормальный закон распределения с параметрами а и  , если её плотность вероятности имеет вид p(x)=

, если её плотность вероятности имеет вид p(x)=  Кривая нормального распределения p(x) (нормальная кривая или кривая Гаусса) приведена на рисунке.

Кривая нормального распределения p(x) (нормальная кривая или кривая Гаусса) приведена на рисунке.

В точке х=a функция достигает своего максимума, кот. равен  График симметр. относит. а. При изменении параметра а форма кривой не меняется, а ее график сдвигается влево или вправо. При изменении параметра σ меняется форма нормальной кривой: с увеличением параметра σ кривая должна приближаться к 0Х и растягиваться вдоль этой оси, а с уменьшением σ кривая стягивается к прямой х=а.

График симметр. относит. а. При изменении параметра а форма кривой не меняется, а ее график сдвигается влево или вправо. При изменении параметра σ меняется форма нормальной кривой: с увеличением параметра σ кривая должна приближаться к 0Х и растягиваться вдоль этой оси, а с уменьшением σ кривая стягивается к прямой х=а.

27. Числовые характеристики случайной величины, имеющей нормальное распределение. Непрерывная случайная величина X имеет нормальный закон распределения с параметрами а и  , если её плотность вероятности p(x) имеет вид p(x)=

, если её плотность вероятности p(x) имеет вид p(x)=  : Математическое ожидание случайной величины X, распределённой по нормальному закону, равно параметру а этого закона, а её дисперсия - квадрату параметра

: Математическое ожидание случайной величины X, распределённой по нормальному закону, равно параметру а этого закона, а её дисперсия - квадрату параметра  , т.е.

, т.е.  Величина М(Х) называется также центром рассеяния, а среднеквадратичное отклонение

Величина М(Х) называется также центром рассеяния, а среднеквадратичное отклонение  характеризует ширину кривой распределения. С возрастанием

характеризует ширину кривой распределения. С возрастанием  максимальная ордината кривой убывает, а сама кривая становится более пологой, растягиваясь вдоль оси абсцисс, тогда как при уменьшении

максимальная ордината кривой убывает, а сама кривая становится более пологой, растягиваясь вдоль оси абсцисс, тогда как при уменьшении  кривая вытягивается вверх, одновременно сжимаясь с боков

кривая вытягивается вверх, одновременно сжимаясь с боков

28. Вер-ть попад-я в зад. интервал нормально распред. случ. в-ны. В-сть зад. откл-я. Правило трех сигм.

Ф-ия распр. нормального распр. СВ Х выражается через ф-ию Лапласа по формуле:

В-сть попадания нормально распр. СВ Х в заданный интервал

В-сть попадания нормально распр. СВ Х в заданный интервал  опр.ф-лой.

опр.ф-лой.  Часто в задачах требуется вычислить вероятность того, что отклонение нормально распределенной случайной величины Х от ее М(х) =а по абсол. величине меньше заданного полож. числа ε. Для этого исп. формула:

Часто в задачах требуется вычислить вероятность того, что отклонение нормально распределенной случайной величины Х от ее М(х) =а по абсол. величине меньше заданного полож. числа ε. Для этого исп. формула:

При реш-и многих важных практич. задач делают предпол-е, что СВ распределена по норм. закону. Возн. вопрос, на каком основании делается такое допущение. Для иссл-я этого вопроса рассм. одну характ. особ-сть норм. распред-я СВ. Найдем в-сти событий: |x-a|<σ ;|x-a|<2σ ; |x-a|<3σ Используем формулу:P(|x-a|<σ)=2Ф(1)=0,6826 P(|x-a|<2σ)=2Ф(2)= 0,9594 P(|x-a|<3σ)=2Ф(3)=0,9973 – это событие практически достоверное. Посмотрим в таблицу: из последнего соотношения следует, что практически все возможные значения норм. распр-я СВ x принадлежат интервалу (a-3σ; a+3σ)

Итак, правило трех σ утверждает, что с очень высокой вер-тью (0,998) практически все значения СВ сосредоточены в инт-ле (a-3σ;а+3σ)

29. Моменты случайной величины. Асимметрия. Эксцесс.

Среди числ. хар-к СВ важное значение имеют моменты, кот. делятся на начальные и центральные.Начальный теор. момент ν порядка k НСВ X определяется равенством .Для ДСВ Х, принимает значение X1, X2, …,Xn с вероятностью P1, P2, …Pn. Центр. теор. момент порядка k НСВ Х определяется рав-вом

.Для ДСВ Х, принимает значение X1, X2, …,Xn с вероятностью P1, P2, …Pn. Центр. теор. момент порядка k НСВ Х определяется рав-вом  .Очевидно, что

.Очевидно, что  Следствия: 1. ν0=1, μ0=1 2. ν1=M(x), μ1=0 3. ν2=M(x2), μ2=D(x), μ2= ν2-ν12 4. μ3=v3-3v1v2+2v13.

Следствия: 1. ν0=1, μ0=1 2. ν1=M(x), μ1=0 3. ν2=M(x2), μ2=D(x), μ2= ν2-ν12 4. μ3=v3-3v1v2+2v13. Математическое ожидание М(Х), или первый начальный момент, характеризует среднее значение распределения случайной величины Х; второй центральный момент, или дисперсия D(X ), — степень рассеяния распределения Х

относительно М(Х).Третий центр. момент служит для хар-ки асимм. распр и опр. по формуле . Эта величина наз. коэфф. ассим.Четвертый центр . момент характ. крутость распр. и выражается через параметр, кот. наз. эксцессом. Эксцесс опр. по формуле

. Эта величина наз. коэфф. ассим.Четвертый центр . момент характ. крутость распр. и выражается через параметр, кот. наз. эксцессом. Эксцесс опр. по формуле  .30. Неравенство Маркова. Если СВ Х принимает неотрицательные значения, т.е. (х≥0, хi≥0) и существует ее мат. ожидание M(x)=a, то для любого положительного числа а числа выполняются неравенства:

.30. Неравенство Маркова. Если СВ Х принимает неотрицательные значения, т.е. (х≥0, хi≥0) и существует ее мат. ожидание M(x)=a, то для любого положительного числа а числа выполняются неравенства:  ;

;  .

. 31. Неравенство Чебышева. Если Х-СВ, мат. ожидание к-рой М(Х) = а, а дисперсия D(Х) конечна, то д/любого числа ε > 0 выполняются неравенства:

Если уточняется закон распределения, то соотв. можно найти и более точное значение вер-ти. Если СВ Х распр. по норм. закону, то хорошо известно правило трех σ, кот. утв, что с очень высокой вер-тью (0,998) практически все знач. СВ сосредоточены в инт-ле (a-3σ;а+3σ).

32. Теорема Чебышева. Если СВ-ы Х1, Х2….Хn попарно независимы и имеют мат. ожид. M(x1), M(x2)….M(xn) и дисперсии D(x1), D(x2)…..D(xn), кот. ограничены одной и той же констанотой С (P(Xi)=C), то при неогр. большом увел. числа n вып. неравенство:

Фактически эту формулу можно интерпретировать как сходимость по вер-ти ср. знач. величин к ср. знач. их мат. ожиданий

Фактически эту формулу можно интерпретировать как сходимость по вер-ти ср. знач. величин к ср. знач. их мат. ожиданий

33. Теорема Бернулли. Значение закона больших чисел. Если вероятность наступления события А в каж-м из n повторных независимых испытаний постоянна, то при неограниченном увеличении числа n испытаний отн-я частота(частость)  наст-я соб-я А стрем-ся по вер-ти к числу p, т.е. для

наст-я соб-я А стрем-ся по вер-ти к числу p, т.е. для

>0

>0  Данное выражение представляет собой опр. вер-ти по Мизесу. Т-ма Б-ли явл-ся теор-ким обосн-ем для стат-го опр-я вер-ти.

Данное выражение представляет собой опр. вер-ти по Мизесу. Т-ма Б-ли явл-ся теор-ким обосн-ем для стат-го опр-я вер-ти.

Неравенство Бернулли:Пусть  n исп-й Бернулли с вер-ю успеха p, q=1-p и m – число успехов. Тогда для

n исп-й Бернулли с вер-ю успеха p, q=1-p и m – число успехов. Тогда для

>0

>0

Общий смысл закона б.ч. — совместное действие большого числа случайных факторов приводит к результату, почти не зависящему от случая.

На этом свойстве основаны методы оценки вероятности на основе анализа конечной выборки. Примером является прогноз результатов выборов на основе опроса выборки избирателей

4. Понятие о центральной предельной теореме.Суть центральной предельной теоремы (ЦПТ) в след.: если СВ Х представляет собой сумму большого числа взаимно независимых случ. в-н, влияние каждой из которых на всю сумму ничтожно мало, то х имеет расп-е, близкое к нормальному.

Центральная предельная теорема (ЦПТ) ( в формулировке Ляпунова А.М. для одинаково распред. СВ): Если попарно независимые СВ X1, X2, ..., Xn, ... имеют одинаковый закон распределения с конечными числовыми характеристиками M[Xi] = m и D[Xi] = s2, то при n ® ¥ закон распределения СВ  неограниченно приближается к норм. закону N(n×m,

неограниченно приближается к норм. закону N(n×m,  ). Следствие. Если в условии теоремы СВ

). Следствие. Если в условии теоремы СВ  , то при n ® ¥ закон распределения СВ Y неограниченно приближается к нормальному закону N(m, s/

, то при n ® ¥ закон распределения СВ Y неограниченно приближается к нормальному закону N(m, s/  ).

).

35. Предмет и метод мат. статистики. МС – раздел мат-ки, кот. изуч. методы сбора, систематизации и обработки рез-тов набл-й с целью выявления стат. зак-стей. МС осн. на понятиях и р-тах ТВ и оперирует непосредственно с р-тами наблюдений над случ. явлением. Ее цель-оценить характер-ки генер. совок-ти по выборочным данным. Предметом МС явл. изуч-е случ. событий и случ. величин по р-там наблюд-й. Осн. задача МС сост. в получ-и выводов о массов. явлениях по данных наблюдения за ними. Др. задачами МС явл.: 1.указать способы сбора и группировки стат. сведений, получ. в р-те наблюдений или в р-те спец. поставл. экспер-тов; 2.разработать методы анализа стат. данных в зав-сти от целей иссл-я. Р-том наблюд-й над стат. совок-стью явл. стат. данные. Обработка стат. данных методами МС приводит к установл-ю опред. законом-стей, присущих массовым явл-ям.

36. Генеральная и выборочная совокупности. Способы отбора. Ген. сов-ть – это множество всех обслед. объектов. В ген. сов-ти выбирают часть объектов и изуч. их. Эта часть объектов наз. выброчной сов-тью. Т.о. в мат. статистике различают два вида наблюдений: сплошное, когда изучаются все объекты совокупности и несплошное (выборочное), когда изучается только часть объектов. Правильная орг-ия выборки явл. самой сложной частью стат. иссл. Правильная орг-ия выборки ведет к понятию репрезент. выборки,т.е. такой выборки, изуч. кот. дает адекватное предст. о ген. сов-ти.

Способы отбора можно подразделить на 2 вида:

1. Отбор, не требующий расчленения ген. сов-ти(случ. бесповт. и повт. отбор)

2. Отбор, при кот. ген. сов-ть разбивается на части (типический отбор, мех. отбор, серийный отбор).

Бесповторная выборка – из генер. совок-ти элементы извлекаются и не возвращаются обратно. Если после извлечения элементов из совок-ти они фиксируются и возвращаются обратно – повторный отбор.

Считается, что одним из наиб. правильных способов выборки явл. случ. отбор из ген. сов-ти, т.е. элементы берутся наугад и каждый из них может быть отобран с одинаковой вероятностью. Кол-во объектов генер. или выбор. сов-ти называют объемом.

Сплошное набл. применяют когда объем генер. совок. небольшой.

37. Постр-е дискретного вар. ряда. Эмпир. функция распр-я и ее св-ва. Пусть для некот. сов-ти изуч. пр-к Х, кот. может быть описан числ, величинами. Обозначим возм. знач. пр-ка Х1 , Х2 ...Хm. Дискретный вариационный ряд (m-объем выборки) называется последовательностью. Из дикретного вар. ряда строится стат. ряд. распр., кот. форм. след. образом: 1. среди всех вар-тов выбир. разл. и упорядоч. по возраст, а также считается, сколько раз каждый член стат. ряда встреч. в дискретном вар. ряду.2. находим размах выборки. (3. иногда вместо стат. ряда записывается ряд, в кот. во второй строке стоят частости) Стат. распред. можно изобр. графически. Для этого на Ох наносят xi, а на Оу – частоты mi. Соединив точки частот, получим ломаную, кот. наз-ся полигоном распр. В завис-ти от того, какие знач. принимает признак стат. распред., вариац. ряды дел. на Дискретные (варианты приним. конкр. значения) и Интервальные (варианты изменяются непрерывно в некот.интервале). Эмпир.функция распр-я.Пусть известно стат. распр-е колич. признака Х; n x – число наблюдений, при кот-х наблюдалось знач-е признака, меньшее x , т.е. Х< x; n – общее число наблюдений (объём выборки). Тогда относ. частота события Х< x есть n х/n. При изм-и x меняется и nх /n, т.е. относительная част. nх /n является функцией x . Так как эта функция находится эмпирически. (т.е. получ. опытным) путём, то её наз. эмпирической. Итак , эмпир. функцией распр-я (функцией распр-я выборки) наз. функция  опред. для каждого знач-я xÎR относ. частоту события Х< x. Т.к. в этой ф-ле nх – число вариант, меньших x, поэтому для расчетов удобна ф-ла вида

опред. для каждого знач-я xÎR относ. частоту события Х< x. Т.к. в этой ф-ле nх – число вариант, меньших x, поэтому для расчетов удобна ф-ла вида  .

.

38. Построение интерв. вариац. ряда. Гистограмма частот и относ. частот. При большом объеме выборки ее элементы объед. в группы (разряды, интервалы), представляя р-ты опытов в виде интерв. стат. ряда. Для этого весь диапазон значений СВ x (от xmin до xmax ) разбивают на k интервалов одинак. длины h (обычно k меняется от 5 до 20). Число интервалов рекомендуют брать согласно формуле Стерджеса k =1+ 3,93× ln n Затем подсчит. частоты ni (или относит. частоты wi ) знач-й выборки, попавших в выдел. интервалы. Величина ni/h наз. плотностью частоты, а wi/h – плотностью относ. частоты. Пусть xi* – середина i -го интервала, ni – число эл-тов выборки, попавших в i -й интервал. Таким образом, получим группиров. стат. ряд, в верхней строке которого записаны середины соотв. интервалов xi*: xi* x1* x2* …xk*; ni n1 n2 … nk.

Для граф. представления интерв. стат. распределений принято использовать гистограмму частот и гистограмму относ. частот. Гистогр. частот наз. ступенчатую фигуру, сост. из прямоуг., основаниями кот служат частичные инт-лы длиною h, а высоты равны отношению ni/h. Гистограммой относ. частот интервального стат. ряда наз. ступенчатая фигура, составл. из прямоугольников, постр. на интервалах группировки длины h и высоты wi/h так, что площадь каждого прямоугольника равна относительной частоте wi.Для построения гистограммы относительных частот на оси абсцисс откладывают частичные интервалы, а над ними проводят отрезки длиной wi/h параллельно оси ординат. Очевидно, площадь i -го частичного прямоугольника равна wi – относительной частоте вариант, попавших в i -ый интервал. Следовательно, площадь гистограммы относительных частот равна сумме всех относительных частот (т.е. равна 1), а площадь гистограммы частот равна объему выборки n .

Для граф. представления интерв. стат. распределений принято использовать гистограмму частот и гистограмму относ. частот. Гистогр. частот наз. ступенчатую фигуру, сост. из прямоуг., основаниями кот служат частичные инт-лы длиною h, а высоты равны отношению ni/h. Гистограммой относ. частот интервального стат. ряда наз. ступенчатая фигура, составл. из прямоугольников, постр. на интервалах группировки длины h и высоты wi/h так, что площадь каждого прямоугольника равна относительной частоте wi.Для построения гистограммы относительных частот на оси абсцисс откладывают частичные интервалы, а над ними проводят отрезки длиной wi/h параллельно оси ординат. Очевидно, площадь i -го частичного прямоугольника равна wi – относительной частоте вариант, попавших в i -ый интервал. Следовательно, площадь гистограммы относительных частот равна сумме всех относительных частот (т.е. равна 1), а площадь гистограммы частот равна объему выборки n .

39. Выборочная средняя, выборочная дисперсия и их свойства Выборочная средняя. Пусть для изучения генеральной совокупности относительно количественного признака Х извлечена выборка объема n. Выборочной средней называют среднее арифметическое значение признака выборочной совокупности. Если все значения признака выборки различны, то  если же все значения имеют частоты n1, n2,…,nk, то

если же все значения имеют частоты n1, n2,…,nk, то  Выборочная средняя является несмещенной и состоятельной оценкой генеральной средней. Замечание: Если выборка представлена интервальным вариационным рядом, то за xi принимают середины частичных интервалов.

Выборочная средняя является несмещенной и состоятельной оценкой генеральной средней. Замечание: Если выборка представлена интервальным вариационным рядом, то за xi принимают середины частичных интервалов.

Выборочная дисперсия. Для того, чтобы наблюдать рассеяние количественного признака значений выборки вокруг своего среднего значения, вводят сводную характеристику- выборочную дисперсию. Выборочной дисперсией называют среднее арифметическое квадратов отклонения наблюдаемых значений признака от их среднего значения . Если все значения признака выборки различны, то  если же все значения имеют частоты n1, n2,…,nk, то

если же все значения имеют частоты n1, n2,…,nk, то

40. Точечное оцен-е числ. хар-к СВ. Состоят-сть, эффективность, несмещенность оценки. Исправл. выбор. дисперсия. Точ. оценкой хар-ки θ наз. некот. ф-цию  р-тов наблюд-й, знач-я кот-ой близки к неизв. хар-ке θ генер. совок-сти. Для постр-я оценки нужны критерии:1.Несмещеность. Оценка

р-тов наблюд-й, знач-я кот-ой близки к неизв. хар-ке θ генер. совок-сти. Для постр-я оценки нужны критерии:1.Несмещеность. Оценка  наз. несмещ., если её мат. ожид-е равно оцениваемой хар-ке СВ:

наз. несмещ., если её мат. ожид-е равно оцениваемой хар-ке СВ:  , т. е. если она не дает системат. ошибки. 2.Состоятельность. Оценка наз. состоят., если при увел-и числа набл-й оценка сходится по вероятности к искомой вел-не, т. е. для любого сколь угодно малого

, т. е. если она не дает системат. ошибки. 2.Состоятельность. Оценка наз. состоят., если при увел-и числа набл-й оценка сходится по вероятности к искомой вел-не, т. е. для любого сколь угодно малого

. Состоят-сть означ., что оценка, постр. по большому числу наблюд-й, имеет меньший разброс (дисперсию), т. е.

. Состоят-сть означ., что оценка, постр. по большому числу наблюд-й, имеет меньший разброс (дисперсию), т. е.  . 3.Эф-ть. Желательно иметь оценки, кот-е имеют наим. дисперсию среди всех оценок, постр. по n набл-ям. Такие оценки наз. эффективн..

. 3.Эф-ть. Желательно иметь оценки, кот-е имеют наим. дисперсию среди всех оценок, постр. по n набл-ям. Такие оценки наз. эффективн..

Точечная оценка мат. ожидания. Пусть изуч. СВ Х с МX=а и DX,причем оба параметра неизв.Статистика (т.е. ф-ия ) наз. точечной оценкой парматера. Др. словами, точечная оценка – это конкр. число, опр. по выборке.

Пусть Х1,Х2,...,Хn – выборка объема n. Тогда сост. и несмещенной оценкой МХ явл выборочная средняя Х (с чертой сверху). Док-во этого соотн. осн. на теореме Чебышева. На практике, к.п., в кач-ве оценки МХ исп. ср. арифм.

Точечная оценка дисперсии. Доказано, что DвХ связана с DX СВ Х след. формулой:

DВХ=  , т.е. М(DвХ)=DX,т.е. DвХ явл. смещенной оценкой дисперсии. Поэтому,чтобы получить несмещ. оценку дисп, DвХ испраляют, умножив ее на

, т.е. М(DвХ)=DX,т.е. DвХ явл. смещенной оценкой дисперсии. Поэтому,чтобы получить несмещ. оценку дисп, DвХ испраляют, умножив ее на  и обозн.

и обозн.  .

.  . Исправл. выборочная дисп. явл. несмещенной, состоятельной оценкой дисперсии.

. Исправл. выборочная дисп. явл. несмещенной, состоятельной оценкой дисперсии.

41. Интервальные оценки числовых характеристик случайной величины. Доверительная вероятность. Доверительный интервал.

Пусть сделана выборка объема n. Для оценки распределения СВ Х генеральной совокупности применяются точечные оценки параметров распределения генеральной совокупности и интервальные оценки.

Будем предполагать, что пр-к в ген. сов-ти распр. по норм. закону и считаем, что наша оценка МХ несмещенная. Тогда М(Х с крышкой)=х0. Тогда, восп. формулой

Из формулы след., что неизв. вел. ср.ген.выборки х0 содержится в инт-ле (  ) с вер-тью, равной р, где р вычисл по формуле:

) с вер-тью, равной р, где р вычисл по формуле:

- доверительная вер-ть. Восп. таблицей значений ф-ии Лапласа (Ф), по известной вер-ти можно опр. значение аргумента ф-ии, и рассчитать величину

- доверительная вер-ть. Восп. таблицей значений ф-ии Лапласа (Ф), по известной вер-ти можно опр. значение аргумента ф-ии, и рассчитать величину  .

.

Этот инт-л  наз. доверительным для средней

наз. доверительным для средней  . Как правило, в задачах дов. вер-ть задана и необх. найти довер. инт-л. Обычно на практике доверительная вер-ть берется на Ур-не (0,95; 0,99; 0,999)

. Как правило, в задачах дов. вер-ть задана и необх. найти довер. инт-л. Обычно на практике доверительная вер-ть берется на Ур-не (0,95; 0,99; 0,999)

Т.о. интервальной оценкой (доверительным интервалом) для оценки некоторого параметра q (тэта), например  , называется интервал, в котором с заранее заданной вероятностью Р=1-a содержится оцениваемый параметр.

, называется интервал, в котором с заранее заданной вероятностью Р=1-a содержится оцениваемый параметр.

42. Основные понятия регрессионного и корреляционного анализа. Функцион. зависимость (y=f(x)) м-ду величинами X и Y закл. в том, что каждому значению одной переменной соответствует вполне опред. значение другой. Статистической наз.т зависимость, при которой изменение одной из величин влечет изменение распределения другой. В частности,статистическая зависимость проявляется в том, что при изменении одной из величин изменяется среднее значение другой. В этом случае стат. зав-ть наз. корреляционной зав-тью.Корреляционной (или регрессионной) зависимостью между двумя переменными величинами называется функциональная зависимость между значениями одной из них и условным математическим ожиданием другой. Условное мат. ожидание Mx (Y) СВ Y есть функция от x : Mx (Y) f (x) , которую называют функцией регрессии Y на X . Корреляц. зависимостью Y от X называется функц. зависимость условной средней  x от x . Уравнение y f xназ. уравн-ем регрессии Y на X . Функция f xназ. регрессией Y на X , а ее график – линией регрессии СВ Y на СВ X . Осн. задачи теории корреляции: 1. Установл. формы корреляционной связи; 2. Оценка тесноты корреляционной связи Y от X , кот. оценивается величиной рассеяния значений Y около Yx. Большое рассеяние означает слабую зависимость Y от X либо вообще отсутствие таковой. Малое рассеяние указывает на существование достаточно сильной зависимости Y от X . Важной с точки зрения приложений является ситуация, когда обе функции регрессии f (x),yявляются линейными. Тогда говорят, что СВ X и Y связаны линейной корреляц. зав-стью (линейной корреляцией).

x от x . Уравнение y f xназ. уравн-ем регрессии Y на X . Функция f xназ. регрессией Y на X , а ее график – линией регрессии СВ Y на СВ X . Осн. задачи теории корреляции: 1. Установл. формы корреляционной связи; 2. Оценка тесноты корреляционной связи Y от X , кот. оценивается величиной рассеяния значений Y около Yx. Большое рассеяние означает слабую зависимость Y от X либо вообще отсутствие таковой. Малое рассеяние указывает на существование достаточно сильной зависимости Y от X . Важной с точки зрения приложений является ситуация, когда обе функции регрессии f (x),yявляются линейными. Тогда говорят, что СВ X и Y связаны линейной корреляц. зав-стью (линейной корреляцией).

44. Коэффициент линейной корреляции и его свойства.  - корреляционный момент (ковариация), где K(X ,Y ) M{[X M(X )][Y M(Y)]} Две случайные величины X и Y называются коррелированными, если их коэф-т корреляции отличен от нуля. СВ X и Y называются некоррелированными, если их корреляционный момент равен нулю.

- корреляционный момент (ковариация), где K(X ,Y ) M{[X M(X )][Y M(Y)]} Две случайные величины X и Y называются коррелированными, если их коэф-т корреляции отличен от нуля. СВ X и Y называются некоррелированными, если их корреляционный момент равен нулю.  выборочный коэф. коррел. Свойства коэф-та корреляции: 1. Коэф-т корреляции

выборочный коэф. коррел. Свойства коэф-та корреляции: 1. Коэф-т корреляции  принимает значения на отрезке [1;1], т.е. 1 1 в 1r 1; 2.Если все значения переменных увеличить (уменьшить) на одно и то же число или в одно и то же число раз, то величина выборочного коэф-та корреляции не изменится. 3.При 1 r = ±1 корреляц. связь представл. линейную функц. зависимость. При этом линии регрессии Y на X и X на Y совпадают, все наблюдаемые значения располагаются на общей прямой. 4.Если с ростом значений одной СВ значения второй возрастают, то 0 в r > , если убывают, то 0 в r < . 5.При 0 в r = линейная корреляц. связь отсутствует, групповые средние переменных совпадают с их общими средними, а линии регрессии Y на X и X на Y параллельны осям координат. Выборочный коэф-т корреляции r является оценкой генерального коэф-та корреляции

принимает значения на отрезке [1;1], т.е. 1 1 в 1r 1; 2.Если все значения переменных увеличить (уменьшить) на одно и то же число или в одно и то же число раз, то величина выборочного коэф-та корреляции не изменится. 3.При 1 r = ±1 корреляц. связь представл. линейную функц. зависимость. При этом линии регрессии Y на X и X на Y совпадают, все наблюдаемые значения располагаются на общей прямой. 4.Если с ростом значений одной СВ значения второй возрастают, то 0 в r > , если убывают, то 0 в r < . 5.При 0 в r = линейная корреляц. связь отсутствует, групповые средние переменных совпадают с их общими средними, а линии регрессии Y на X и X на Y параллельны осям координат. Выборочный коэф-т корреляции r является оценкой генерального коэф-та корреляции

45. Стат. гипотеза. Стат. критерий проверки гипотез. Ошибки 1 и 2 рода. Критич. область. Стат. гипотеза – любое предпол. относит. генер. сов-ти, кот. проверяется путем анализа данных выборки. Выдвинутую гипотезу наз. основной или нулевой Но. наряду с Но рассм. противоречащую ей гипотезу Н1, кот. наз-ся альтернативной или конкурирующей. Выдвинутая гипотеза должна быть проверена стат. методами. По итогам проверки гипотеза либо принимается, либо отклоняется. При этом могут быть допущены ошибки 2 родов: ошибки 1 рода сост. в том, что будет принята гипотеза Н1, в то время как верной явл. гипотеза Но. Вер-ть ошибки 1 рода обозн.  и ее наз. уровнем

и ее наз. уровнем  . Ошибка 2 рода сост. в том, что будет принята гипотеза Но, в то время как верной явл. гипотеза Н1. Вероятность ош. 2 рода обозн.

. Ошибка 2 рода сост. в том, что будет принята гипотеза Но, в то время как верной явл. гипотеза Н1. Вероятность ош. 2 рода обозн.

. Стат. критерием наз. СВ К, кот. служит для проверки нулевой гипотезы. Множ-во всех возм. значений критерия К разбивается на 2 непересек. подмнож-ва – критич. область (мн-во значений критерия, при кот. нулевую гипотезу отвергают) и обл. принятия гипотезы (мн-во значений критерия, при кот. нулевую принимают). По данным выб-ки выч-ся значение К наблюдаемое, кот. наз. наблюдаемым знач-ем. Правило проверки стат. гипот.:если значение К набл. попадает в обл. принятия, то Но приним-ся; если значен. К набл. попадает в критич. обл., то гип. Но отверг-ся. Мощностью критерия наз. вер-ть того, что будет принята конкурир. гипотеза Н1 если она явл. верной. Если

. Стат. критерием наз. СВ К, кот. служит для проверки нулевой гипотезы. Множ-во всех возм. значений критерия К разбивается на 2 непересек. подмнож-ва – критич. область (мн-во значений критерия, при кот. нулевую гипотезу отвергают) и обл. принятия гипотезы (мн-во значений критерия, при кот. нулевую принимают). По данным выб-ки выч-ся значение К наблюдаемое, кот. наз. наблюдаемым знач-ем. Правило проверки стат. гипот.:если значение К набл. попадает в обл. принятия, то Но приним-ся; если значен. К набл. попадает в критич. обл., то гип. Но отверг-ся. Мощностью критерия наз. вер-ть того, что будет принята конкурир. гипотеза Н1 если она явл. верной. Если  - вер-ть ошибки 2 рода, то мощн-ть критерия = 1-

- вер-ть ошибки 2 рода, то мощн-ть критерия = 1-

46. Проверка гипотезы о математическом ожидании нормально распределенной случайной величины. Пусть имеется нормально распр. СВ x,, опред. на мн-стве объектов некот. генер.сов-сти. Известно, что Dx = s 2. Мат. ожидание Mx неизвестно. Допустим, что Mx = a, где a – некот. число. Будем считать также, что имеется другая информация, что Mx = a1, где a1 > a. I. Выдвиг. нулевую гипотезу H0: Mx = a при конкур. гипотезе H1: Mx = a1. Делаем выборку объема n: x1, x2,..., xn . В основе проверки лежит тот факт, что случ. вел-на  (выбор. средняя) распр-на по норм. закону с дисперсией s 2/n и мат.ож-ем, равным a в случае справ-сти H0, и равным a1 в случае справ-сти H1.Очевидно, что если вел-на

(выбор. средняя) распр-на по норм. закону с дисперсией s 2/n и мат.ож-ем, равным a в случае справ-сти H0, и равным a1 в случае справ-сти H1.Очевидно, что если вел-на  оказ. достаточно малой, то это дает основ-е предпочесть г-зу H0 г-зе H1. При дост-но большом знач-и

оказ. достаточно малой, то это дает основ-е предпочесть г-зу H0 г-зе H1. При дост-но большом знач-и  более вероятна справ-сть гипотезы H1. В кач. стат. критерия выбир. СВ. Z = (x с чертой – а)*(корень из n)/(ср. кв. откл-е), распр. по норм. закону, причем Mz = 0 и Dz = 1 в случае справ-сти гипотезы H0. Если справедл. гипотеза H1, то

более вероятна справ-сть гипотезы H1. В кач. стат. критерия выбир. СВ. Z = (x с чертой – а)*(корень из n)/(ср. кв. откл-е), распр. по норм. закону, причем Mz = 0 и Dz = 1 в случае справ-сти гипотезы H0. Если справедл. гипотеза H1, то

Mz = a* = ( a1 – a )  /s, Dz = 1.Если вел-на

/s, Dz = 1.Если вел-на  , получ. из выбор. данных, относ-но велика, то и вел-на z велика, что явл. свид-вом в пользу г-зы H1. Относ-но малые знач-я

, получ. из выбор. данных, относ-но велика, то и вел-на z велика, что явл. свид-вом в пользу г-зы H1. Относ-но малые знач-я  приводят к малым знач-ям z, что свид-вует в пользу г-зы H0. Отсюда следует, что д. б. выбрана правостор. крит. область. По принятому уровню знач-сти a (напр., a = 0,05), используя то, что СВ z распр-на по норм. закону, опр. знач-е Kкр из ф-лы a = P(Kкр < z <¥) = F(¥) – F(Kкр) = 0,5 – F(Kкр).Отсюда Ф(Ккр)=(1-2альфа)/2. Если в-на z, получ. при выбор. знач-и

приводят к малым знач-ям z, что свид-вует в пользу г-зы H0. Отсюда следует, что д. б. выбрана правостор. крит. область. По принятому уровню знач-сти a (напр., a = 0,05), используя то, что СВ z распр-на по норм. закону, опр. знач-е Kкр из ф-лы a = P(Kкр < z <¥) = F(¥) – F(Kкр) = 0,5 – F(Kкр).Отсюда Ф(Ккр)=(1-2альфа)/2. Если в-на z, получ. при выбор. знач-и  , попад. в область принятия г-зы (z < Kкр), то г-за H0 приним. Если в-на z попад. в крит. область, то г-за H0 отверг. II. Если в предыд. задаче поставить др. условие: H0: Mx = a; H1: Mx = a1 , a1 < a, то здесь придется рассм. левостор. крит. область. Здесь a* = ( a1 – a )

, попад. в область принятия г-зы (z < Kкр), то г-за H0 приним. Если в-на z попад. в крит. область, то г-за H0 отверг. II. Если в предыд. задаче поставить др. условие: H0: Mx = a; H1: Mx = a1 , a1 < a, то здесь придется рассм. левостор. крит. область. Здесь a* = ( a1 – a )  /s, а вел-на Kкр опр. из ф-лы a = P(–¥ <z< Kкр) = F( Kкр) – F(–¥) = F( Kкр) + 1/2.Используя формулу –F( Kкр) = F( –Kкр), получаем: F( –Kкр)=(1-2альфа)/2. Знач-я z, вычисл. по выбор. данным, превыш. Kкр, согласуются с г-зой H0. Если в-на z попад. в крит. область (z < Kкр), то г-зу H0 следует отвергнуть, считая предпочт. г-зу H1.III. Рассмотрим теперь такую задачу: H0: Mx = a; H1: Mx ¹ a. В данном случае следует рассм. двустор. крит. область. Крит. знач-е Kкр опр-ся с пом. соотн-я P(–Kкр < z < Kкр) = 1 – a = F( Kкр) – F( – Kкр) = 2F( Kкр) .Из этого соотн-я следует: F( Kкр) = )=(1-альфа)/2.

/s, а вел-на Kкр опр. из ф-лы a = P(–¥ <z< Kкр) = F( Kкр) – F(–¥) = F( Kкр) + 1/2.Используя формулу –F( Kкр) = F( –Kкр), получаем: F( –Kкр)=(1-2альфа)/2. Знач-я z, вычисл. по выбор. данным, превыш. Kкр, согласуются с г-зой H0. Если в-на z попад. в крит. область (z < Kкр), то г-зу H0 следует отвергнуть, считая предпочт. г-зу H1.III. Рассмотрим теперь такую задачу: H0: Mx = a; H1: Mx ¹ a. В данном случае следует рассм. двустор. крит. область. Крит. знач-е Kкр опр-ся с пом. соотн-я P(–Kкр < z < Kкр) = 1 – a = F( Kкр) – F( – Kкр) = 2F( Kкр) .Из этого соотн-я следует: F( Kкр) = )=(1-альфа)/2.

47. Проверка гипотезы о равенстве математических ожиданий двух нормально распределенных случайных величин. Предполож., что имеются случ. выборки х1, х2, ..., хп и y1, y2, ..., ym знач-й двух независ. нормально распред. СВ  и

и  и требуется проверить гипотезу

и требуется проверить гипотезу  о рав-ве мат. ожиданий этих СВ. (а) Если известно, что дисперсии случайных величин и равны,

о рав-ве мат. ожиданий этих СВ. (а) Если известно, что дисперсии случайных величин и равны,  (значение

(значение  неизвестно), то можно получить след. объедин.несмещ. оценку для

неизвестно), то можно получить след. объедин.несмещ. оценку для

В этом сл. s2/n и s2/m будут несмещ. оценками для дисперсии выборочных средних

В этом сл. s2/n и s2/m будут несмещ. оценками для дисперсии выборочных средних  и

и  , а сумма s2/n+s2/m – несмещ. оценкой для дисперсии разности средних

, а сумма s2/n+s2/m – несмещ. оценкой для дисперсии разности средних  . Соотв-но, статистика

. Соотв-но, статистика  как можно показать, будет иметь t-распред-е с n+m-2 степенями свободы. Крит. область уровня

как можно показать, будет иметь t-распред-е с n+m-2 степенями свободы. Крит. область уровня  для проверки гипотезы

для проверки гипотезы  против двустор. альтернативы

против двустор. альтернативы  будет состоять из двух бесконечных полуинтервалов

будет состоять из двух бесконечных полуинтервалов  и

и  , против одностор. альтернативы

, против одностор. альтернативы  - из полуинтервала

- из полуинтервала  и против альтернативы

и против альтернативы  - из полуинт-ла

- из полуинт-ла  , где

, где  ,

,  ,

,  ,

,  обознач. соотв. квантили t-распред-я с n+m-2 степенями свободы.

обознач. соотв. квантили t-распред-я с n+m-2 степенями свободы.

(б) Если нет оснований считать, что дисперсии СВ и равны, то для каждой из дисперсий  и

и  вычисл. своя оценка

вычисл. своя оценка  и соотв-нно модифиц. статистика критерия

и соотв-нно модифиц. статистика критерия  которая, как можно показать, имеет t-распред-е с числом степеней свободы, равным целой части от 1/k, где k выражается след. формулой

которая, как можно показать, имеет t-распред-е с числом степеней свободы, равным целой части от 1/k, где k выражается след. формулой

48. Критерий согласия Пирсона о предполагаемом законе распределения случайной величины. 1.) Исходя из теоретического (предполагаемого закона распределения), находим вероятности рi попадания СВ в каждый из заданных интервалов таблицы, например в случае нормального распределения  .

.

2.) Вычисляем значение c2 соответствующее опытным данным по формуле:

3.) По табл. критических точек c2, учитывая число степеней свободы k=m-r-1, где m – число интервалов, r – число оцениваемых параметров в распределении (для нормального распределения r=2) – находим по таблице c2крит.

4.) Если c2вычисленное<c2крит., то гипотеза о нормальном распределении принимается. Если же c2вычисленное>c2крит., гипотеза отвергается.

Замечание: При нахождении c2крит. учитывается уровень значимости критерия, который обозначается a(q). Уровень значимости критерия для технических задач обычно принимается a=0,05. Он означает вероятность того, что событие не наступит при данных условиях.

49. Критерий согласия Колмогорова о предполагаемом законе распределения случайной величины. 1.) По результатам n – независимых опытов найти эмпирическую функцию распределения: F*(x)

2.) Определить максимум модуля: |F*(x)-F(x)| во всех точках.

3.) Вычислить выборочную статистику  .

.

4.) Сравниваем значения lвыборочн. с критическим значением l, определенным по табл. 5.) Если lвыборочн<lкрит. – гипотеза принимается, если lвыборочн>lкрит. – гипотеза отвергается.

50. Основные понятия дисперсионного анализа. Однофакторный и двухфакторный дисперсионный анализ Дисперсионный анализ примен.для исслед-я влияния 1 или неск.кач. переменных на 1 завис.колич.пер-ную . В основе дисперс. анализа лежит предпол-е о том, что одни переменные могут рассматриваться как причины (независ. переменные): , а другие как следствия (завис.переменные). Независ. переменные наз. иногда регулир. ф-рами именно потому, что в эксперименте иссл-ль имеет возм-сть варьировать ими и анализ-ть получающийся рез-т.Осн. целью дисперс. анализа явл. исслед-е значимости различия между средними с пом. сравнения (анализа) дисперсий. Раздел-е общей дисперсии на несколько источников, позволяет сравнить дисперсию, вызванную различием между группами, с дисперсией, вызванной внутригрупп. изменчивостью. При истинности нулевой гипотезы (о равенстве средних в неск. группах наблюдений, выбранных из генер. совок-сти), оценка дисперсии, связанной с внутригруп. изменчивостью, д. б. близкой к оценке межгрупп. дисперсии. Сущность дисп. анализа закл. в расчленении общей дисперсии изуч. признака на отд. компоненты, обусловл. влиянием конкр. ф-ров, и проверке гипотез о значимости влияния этих ф-ров на исслед. признак. Сравнивая комп-ты дисперсии друг с другом посредством F—критерия Фишера, можно определить, какая доля общей вариативности результат. признака обусловлена действием регулир. ф-ров. Исходным мат-лом для дисп.анализа служат данные исслед-я 3 и более выборок: , которые могут быть как равными, так и неравными по численности, как связными, так и несвязными. По кол-ву выявляемых регулир. ф-ров дисп. анализ м. б. однофакт. (при этом изуч. влияние 1 фактора на рез-ты эксперимента), двухфакт. (при изучении влияния двух факторов) и многофакт. (позволяет оценить не только влияние каждого из факторов в отдельности, но и их взаимодействие). Дисп. анализ относится к группе параметрич. методов и поэтому его следует применять только тогда, когда доказано, что распред-е явл. нормальным. Дисп. анализ исп., если зависимая переменная измер. в шкале отношений, интервалов или порядка, а влияющие переменные имеют нечисловую природу (шкала наименований).